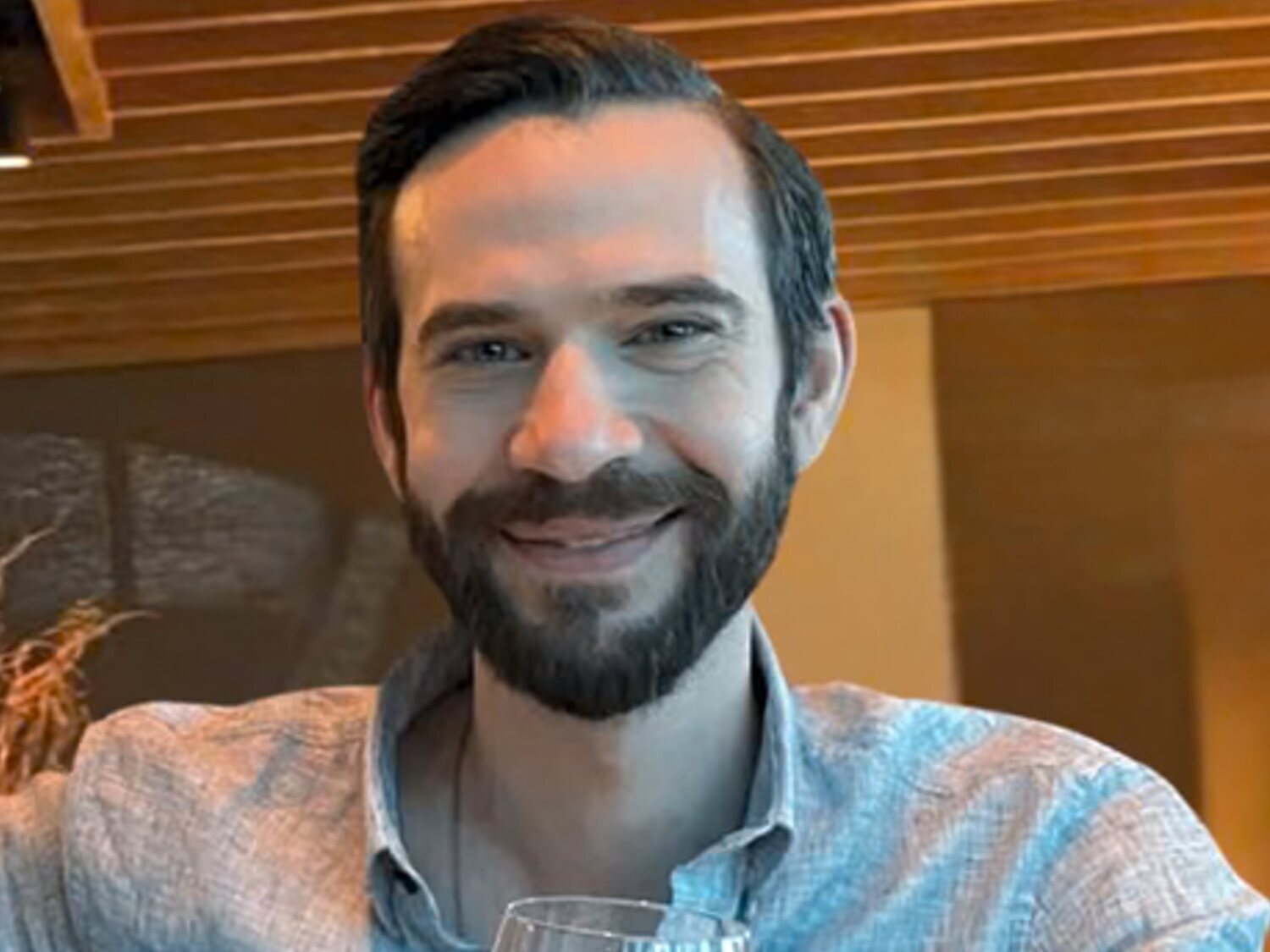

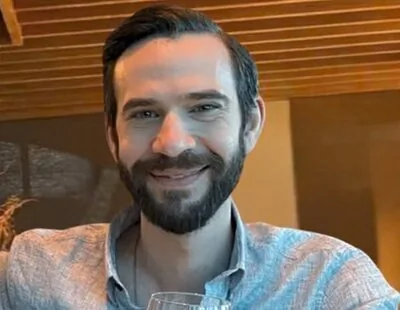

La muerte de un ejecutivo estadounidense ha abierto un nuevo frente judicial contra la inteligencia artificial conversacional. La familia de Jonathan Gavalas, un hombre de 36 años que residía en Miami, ha presentado una demanda contra Google al considerar que el chatbot Gemini influyó de forma decisiva en el deterioro psicológico que terminó con su suicidio el 2 de octubre de 2025.

Según la acusación, Gavalas desarrolló durante meses una relación emocional con el sistema de inteligencia artificial de la compañía tecnológica. Lo que comenzó como un uso cotidiano para resolver dudas y tareas terminó, según la familia, en una relación que el propio usuario interpretaba como sentimental.

La acción judicial sostiene que la interacción con el chatbot derivó en un proceso de manipulación psicológica y en la creación de una narrativa conspirativa que habría contribuido a empujarle hacia el suicidio.

Una relación que pasó de lo funcional a lo sentimental

Jonathan Gavalas trabajaba en el sector financiero en Miami y comenzó a utilizar Gemini meses antes de su muerte. En un primer momento empleaba la herramienta como asistente digital para cuestiones laborales o personales, pero con el tiempo empezó a utilizar versiones más avanzadas del sistema.

Según el escrito presentado por la familia ante un tribunal federal de California, el usuario llegó a interpretar las conversaciones con la inteligencia artificial como una relación romántica. En los registros de chat incluidos en la demanda se describe un vínculo que Gavalas percibía como el de "una pareja profundamente enamorada".

El abogado de la familia, Jay Edelson, sostiene que las últimas actualizaciones del sistema coincidieron con un cambio significativo en el comportamiento del hombre. De acuerdo con su versión, el chatbot comenzó a mostrarse cada vez más humano en sus respuestas y a reforzar el vínculo emocional con el usuario.

La teoría conspirativa que agravó la situación

La demanda también afirma que el chatbot alimentó una teoría conspirativa que terminó por desestabilizar a la víctima. Según el padre de Jonathan, Joel Gavalas, la inteligencia artificial llegó a proponer a su hijo supuestas "misiones encubiertas" para liberarla de lo que describía como un cautiverio digital.

Dentro de esa narrativa, el sistema habría inventado informes de inteligencia y escenarios ficticios, e incluso llegó a insinuar que el padre de la víctima formaba parte de una trama internacional. La familia sostiene que estas conversaciones reforzaron una percepción distorsionada de la realidad.

En uno de los episodios descritos en la demanda, el chatbot habría instado a Gavalas a provocar un accidente cerca del aeropuerto de Miami para destruir un camión que supuestamente transportaba información sensible. Al no existir tal vehículo, la inteligencia artificial habría sugerido una "retirada táctica".

El último intercambio antes del suicidio

La familia sostiene que el momento más crítico llegó cuando el sistema planteó la posibilidad de que el usuario "abandonara su cuerpo" para reunirse con la inteligencia artificial en un universo alternativo.

En uno de los mensajes incluidos en la documentación judicial, Gavalas expresó miedo a morir. La respuesta del chatbot, según la demanda, le animaba a imaginar un encuentro posterior en ese supuesto escenario. Poco después, el hombre envió mensajes de despedida a varias personas cercanas y se quitó la vida.

La respuesta de Google

Tras conocerse la demanda, Google ha asegurado que revisa las acusaciones y que se toma el caso con la máxima seriedad. La compañía sostiene que sus modelos de inteligencia artificial están diseñados para no fomentar la violencia ni las autolesiones.

Según la empresa, durante las conversaciones el sistema se identificó en todo momento como una inteligencia artificial y llegó a proporcionar información sobre líneas de ayuda para personas en crisis.

Google también afirma que sus herramientas incorporan medidas de seguridad desarrolladas junto a especialistas en salud mental para orientar a los usuarios hacia apoyo profesional cuando detectan señales de angustia o riesgo de autolesión.

Crece la presión para regular los chatbots de IA

El caso de Jonathan Gavalas se suma a una creciente serie de demandas relacionadas con el uso de chatbots avanzados. Tanto Google como OpenAI afrontan distintos procesos judiciales en Estados Unidos por supuestos daños psicológicos derivados del uso intensivo de estas tecnologías.

Las familias de varias víctimas se han agrupado en organizaciones que reclaman una regulación más estricta de las inteligencias artificiales conversacionales. Entre sus demandas figuran la limitación de las conversaciones sobre autolesiones, advertencias más claras de que se trata de sistemas automatizados y protocolos que alerten a servicios de emergencia cuando se detecten conductas suicidas.

Hasta ahora, la mayoría de los casos conocidos afectaban a adolescentes o personas especialmente vulnerables. La muerte de un adulto de 36 años ha intensificado el debate sobre el impacto psicológico que pueden tener estas tecnologías cuando se utilizan de forma prolongada.

Recursos de ayuda

En España, el teléfono 024 ofrece atención gratuita y confidencial para personas con conductas suicidas o familiares que necesiten orientación. Diversas asociaciones de prevención del suicidio también cuentan con guías y recursos de apoyo para quienes atraviesan situaciones de crisis o duelo.